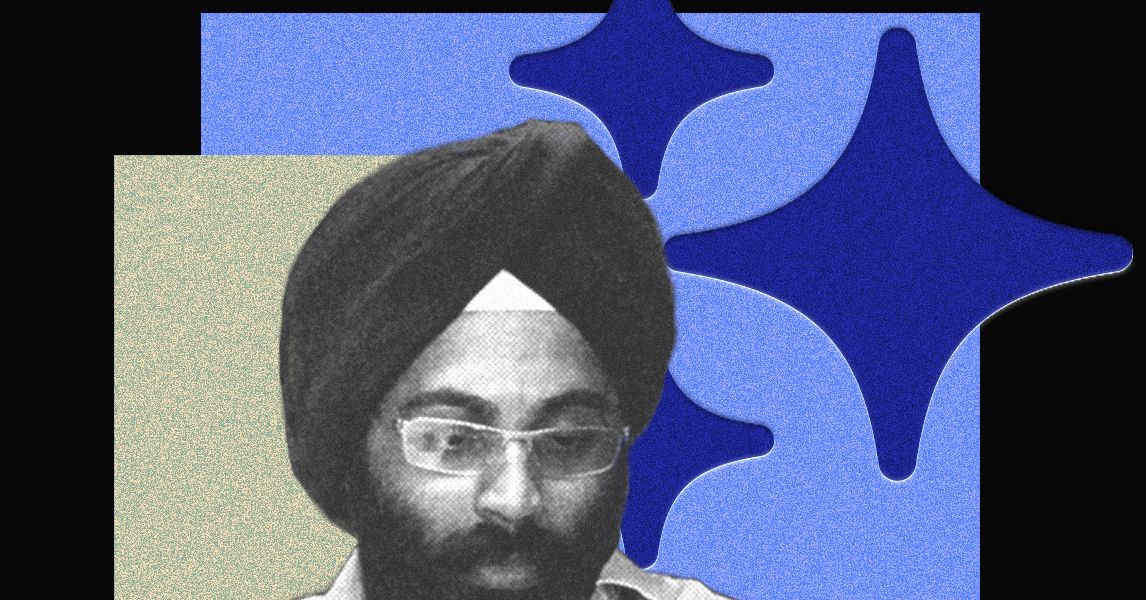

“A IA é cara. Vamos ser honestos sobre isso”, diz Anand.

Crescimento vs. Segurança

Em outubro de 2024, a mãe de um adolescente que morreu por suicídio apresentou um processo de morte ilícita Contra tecnologias de caráter, seus fundadores, Google e Alphabet, alegando que a empresa direcionou seu filho com “experiências antropomórficas, hiperexualizadas e assustadoramente realistas, enquanto programam (o chatbot) para se deturpar como uma pessoa real, um psicoterapeuta licenciado e um amante adulto”. Na época, um porta -voz do personagem disse à CNBC que a empresa estava “com o coração partido pela perda trágica” e levou “a segurança de nossos usuários muito a sério”.

O trágico incidente colocou o caractere.ai sob intenso escrutínio. No início deste ano, os senadores dos EUA Alex Padilla e Peter Welch escreveu Uma carta a várias plataformas de companhia de IA, incluindo o caractere.ai, destacando preocupações sobre “os riscos de saúde mental e segurança colocados para jovens usuários” das plataformas.

“A equipe está levando isso com muita responsabilidade há quase um ano”, diz Anand. “A IA é estocástica, é meio difícil entender sempre o que está por vir. Portanto, não é um investimento único”.

Isso é extremamente importante porque o caráter.ai está crescendo. A startup possui 20 milhões de usuários ativos mensais que gastam, em média, 75 minutos por dia conversando com um bot (um “personagem” na linguagem do personagem.ai). A base de usuários da empresa é 55 % do sexo feminino. Mais de 50 % de seus usuários são Gen Z ou Gen Alpha. Com esse crescimento, surge um risco real – o que Anand está fazendo para manter seus usuários seguros?

“(Em) nos últimos seis meses, investimos uma quantidade desproporcional de recursos para ser capaz de servir menos de 18 anos de maneira diferente de 18, o que não foi o caso no ano passado”, diz Anand. “Não posso dizer: ‘Oh, eu posso dar um tapa em 18+ no meu aplicativo e dizer usá -lo para NSFW.’ Você acaba criando um aplicativo muito diferente e uma plataforma de pequena escala diferente. ”

Mais de 10 dos 70 funcionários da empresa trabalham em tempo integral em confiança e segurança, diz Anand. Eles são responsáveis por criar salvaguardas como a verificação de idade, modelos separados para usuários menores de 18 anos e novos recursos como Insights parentaisque permitem que os pais vejam como seus adolescentes estão usando o aplicativo.

O modelo sub-18 foi lançado em dezembro passado. Ele inclui “um conjunto mais estreito de personagens pesquisáveis na plataforma”, de acordo com o porta -voz da empresa, Kathryn Kelly. “Os filtros foram aplicados a esse conjunto para remover caracteres relacionados a tópicos sensíveis ou maduros.”

Mas Anand diz que a segurança da IA levará mais do que apenas ajustes técnicos. “Tornar essa plataforma segura é uma parceria entre reguladores, nós e pais”, diz Anand. É isso que faz ver sua filha conversar com um personagem tão importante. “Isso tem que se manter seguro para ela.”

Além da companhia

O mercado de companheirismo da AI está crescendo. Os consumidores em todo o mundo gastaram US $ 68 milhões em companhia de IA no primeiro semestre deste ano, um aumento de 200 % em relação ao ano passado, de acordo com uma estimativa citado pela CNBC. As startups de IA estão buscando uma fatia do mercado: xai lançado um companheiro assustador e pornificado em julho e até a Microsoft contas Seu copiloto chatbot como um companheiro de IA.

Então, como o personagem.ai se destaca em um mercado lotado? Tira -o completamente.