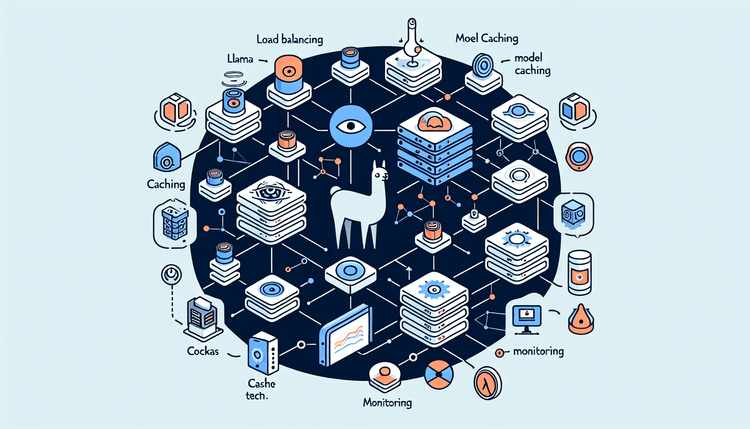

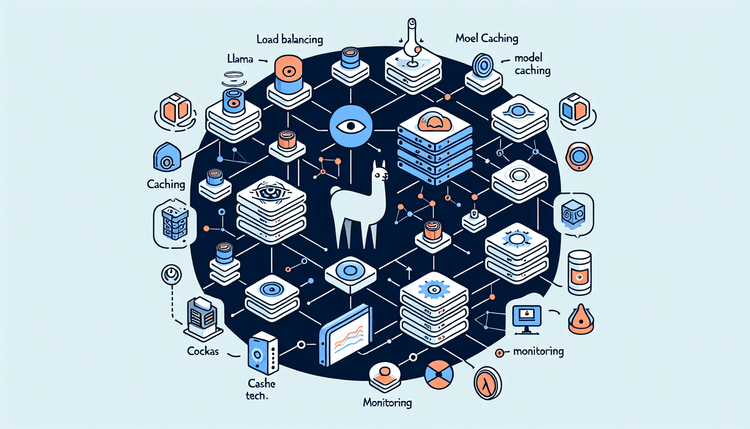

Executar o Llama 3 localmente é fácil. Executá-lo de forma confiável na produção com balanceamento de carga, cache de modelo e monitoramento? Isso requer arquitetura.

Continuar lendo

Da demonstração à produção: LLMs de auto-hospedagem com Ollama e Docker

sobre SitePoint.