-

Código Claude em produção: como manter longas execuções estáveis

Fluxo de trabalho passo a passo para sessões de longa duração, disciplina de contexto, recuperação de falhas e higiene imediata Continuar lendo Código Claude em produção: como manter…

-

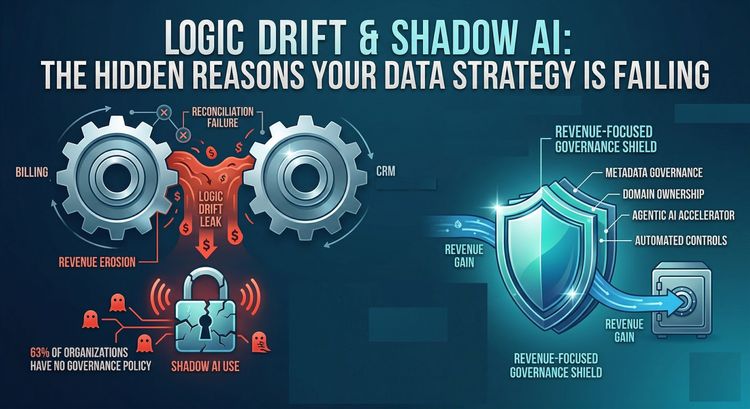

Logic Drift & Shadow AI: os motivos ocultos pelos quais sua estratégia de dados está falhando

nulo Continuar lendo Logic Drift & Shadow AI: os motivos ocultos pelos quais sua estratégia de dados está falhando sobre SitePoint. Source link

-

Melhores cartões de criptomoeda para indianos

Compare os melhores cartões de criptomoeda para indianos em 2026. Abrange Cryptomus, Uquid, PlasBit, Paycent e Bleap para gastar criptografia nas compras diárias. Continuar lendo Melhores cartões de…

-

Semrush One: a solução completa de IA e visibilidade de SEO

Semrush One combina ferramentas de SEO e rastreamento de visibilidade de IA em uma plataforma. Monitore as classificações do Google, visões gerais de IA, menções ao ChatGPT e…

-

Construindo aplicativos modernos baseados em dados: lições de projetos do mundo real na Holanda

nulo Continuar lendo Construindo aplicativos modernos baseados em dados: lições de projetos do mundo real na Holanda sobre SitePoint. Source link

-

Arquitetando a pontuação: a tecnologia por trás da avaliação da entrevista de IA

nulo Continuar lendo Arquitetando a pontuação: a tecnologia por trás da avaliação da entrevista de IA sobre SitePoint. Source link

-

Como usar o Semrush One MCP para potencializar ferramentas de IA com dados reais de SEO

Aprenda como conectar Semrush One MCP ao ChatGPT, Claude e Cursor para obter palavras-chave, backlinks e dados competitivos em tempo real dentro de suas ferramentas de IA automaticamente.…

-

Nimbalyst: o espaço de trabalho visual para construção com Claude Code e Codex

Nimbalyst é um espaço de trabalho visual gratuito para Claude Code e Codex com gerenciamento de sessões, editores visuais, rastreamento de tarefas e fluxos de trabalho git para…

-

5 maneiras principais de usar a API do desenvolvedor Semrush

Aprenda 5 maneiras poderosas de usar a API Semrush para automatizar relatórios, qualificar leads, monitorar concorrentes e desbloquear inteligência de SEO em tempo real em grande escala. Continuar…

-

12 melhores ferramentas de sourcing de recrutamento de IA para 2026

As 12 melhores ferramentas de recrutamento de IA para 2026, comparadas por tamanho do banco de dados, automação de alcance e preços. Mais de 850 milhões de perfis…